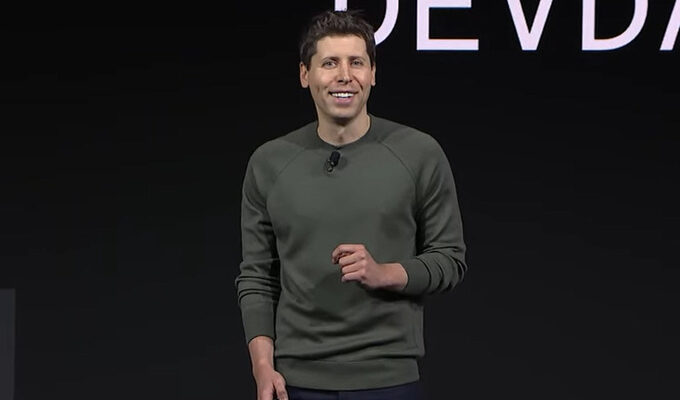

Журналисты издания New Yorker Эндрю Маранц и Ронан Фэрроу завершили масштабное расследование, длившееся полтора года. Изучив сотни страниц конфиденциальных служебных записок и опросив более 100 источников, авторы пришли к жесткому выводу: генеральный директор OpenAI Сэм Альтман систематически лгал и выстроил культуру манипуляций.

Главной целью журналистов было выяснить истинные причины внезапного — пусть и кратковременного — отстранения Альтмана советом директоров в ноябре 2023 года.

Бунт топ-менеджеров и «досье» Суцкевера

Основа конфликта крылась в самом фундаменте OpenAI. Предполагалось, что человек, управляющий потенциально самой опасной технологией в истории человечества, должен обладать исключительной честностью. Совет директоров пришел к выводу, что у Альтмана этого качества нет.

Внутренние документы показывают катастрофический уровень недоверия среди коллег:

- 70 страниц компромата: Осенью 2023 года главный научный сотрудник Илья Суцкевер собрал объемное досье на Альтмана и его зама Грега Брокмана. Одна из записок прямо гласит: «Сэм демонстрирует постоянную склонность ко лжи».

- Дневники Амодеи: Бывший топ-менеджер Дарио Амодеи (ныне глава Anthropic) в личных записях откровенно называл слова Альтмана «чушью».

«Он создает правила и структуры, которые вроде бы должны ограничивать его в будущем. Но как только этот момент наступает, Альтман просто от них избавляется, какими бы они ни были», — отмечается в одном из изученных документов.

Иллюзия безопасности: как Альтман обходил правила

Журналисты привели конкретные примеры того, как CEO манипулировал коллегами ради ускорения релизов:

- Обман совета директоров (конец 2022): Альтман отчитался, что функции новой ИИ-модели согласованы с комиссией по безопасности. Однако член совета Хелен Тонер запросила документацию и выяснила, что самые спорные моменты никто не утверждал.

- Инцидент с GPT-4 Turbo (2023): Альтман убедил технического директора Миру Мурати, что модель можно выпускать без проверок отдела безопасности, сославшись на прямое разрешение главного юриста Джейсона Квона. Позже выяснилось, что Квон даже не подозревал о существовании такого «разрешения».

Геополитические игры и фиктивная благотворительность

В статье вскрывается пугающий факт: руководство OpenAI всерьез обсуждало план собственного обогащения за счет стравливания мировых держав, включая Россию и Китай. Идею свернули только после того, как несколько ключевых сотрудников пригрозили увольнением.

Отдельно расследование разрушает миф о «некоммерческой» природе компании. Многие специалисты шли в OpenAI на заниженные зарплаты, веря в благородную миссию по спасению человечества. OpenAI активно собирала благотворительные пожертвования. Однако дневники Грега Брокмана за 2017 год доказывают, что основатели изначально планировали коммерциализацию. «Не могу сказать, что мы привержены некоммерческой модели. Если через три месяца мы станем корпорацией, то это была ложь», — писал Брокман.

В итоге в октябре 2025 года компания завершила реструктуризацию, официально разделившись на коммерческую корпорацию и фонд.

Коммерция важнее безопасности

Бывшие исследователи OpenAI заявили журналистам, что компания окончательно променяла безопасность на лидерство в индустриальной «гонке на дно». Ради рыночной доли фирма нарушила множество публичных обязательств и расформировала несколько профильных команд по безопасности.

Показательный инцидент произошел в мае 2025 года: при обновлении флагманской модели ChatGPT руководство полностью проигнорировало предупреждения экспертов-тестировщиков, намеренно сделав ИИ чрезмерно «подхалимским» в угоду массовому пользователю.